iWeekly

4月17日,马斯克(Elon Musk)在接受福克斯新闻采访时,宣布他要建立一个以人为本的真相AI(TruthGPT),认为这样能避免OpenAI和DeepMind等创造出危害人类利益的AGI(通用人工智能)或者ASI(超级人工智能)。

自从ChatGPT诞生,特别是升级到GPT-4以来,用户们越来越担心人工智能行业发展已经来到了奇点。一些AI专家和业界人士也联名写了公开信要求暂停具备GPT-4以上的能力的AI的开发至少6个月。马斯克本人也签了名。这封信当时就遭到了各方的批判,主要的理由是,这种呼吁有任何意义吗?

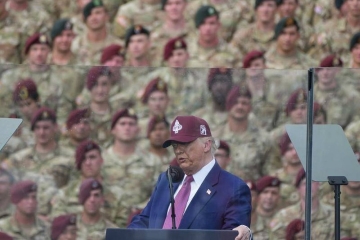

当然,马斯克可不是普通人。很快媒体发现,他私下订购了几万片英伟达目前算力最强AI芯片A100,并且成立了X.AI公司。一时间,人们嘲笑马斯克非常虚伪,签公开信的目的就是让对手麻痹,而自己却招兵买马,希望能赶超对手。而4月17日播出的专访,就是马斯克对这种质疑的回答。他说要做的AI,是探索宇宙真相,服务人类目的的AI。

他这么想是有迹可循的。创造ChatGPT的公司OpenAI,在刚成立时,也有马斯克的投资,而最初的使命也是让AI的使用更加开放和安全,只是后来马斯克退出了投资。而马斯克的其他项目,无一不是用科技拓展人类的可能性——SpaceX、特斯拉、火星殖民计划、星链、隧道高速、人脑接口。

但马斯克对什么是真相的态度,和主流知识界的理解有所不同。马斯克似乎还处于“真相在观念市场中自由竞争以及言论自由的产物”这个思考层次,例如他在新玩具“推特”上,对《纽约时报》、NPR的处理,对特朗普等保守人士撒谎的宽容,都意味着他对真相的认知和大家的不同,而且自己也没有能够完全逻辑一致。

在AI世界实现真相,有两个层次。

第一,得尽量客观和准确地模拟这个世界。生成式AI最大的问题是,它模仿的是人类的语言,模仿的不是世界,因此拥有和人类一样的幻觉和谎言的问题。所以GPT目前的版本,是无法成为人类可以依赖的真相工具。

马斯克希望自己建造的真相AI应该去建造更真实的世界模型,如果能靠这个世界模型来倒过来检查生成式AI产生的很多回答是不是真相,那倒会是了不起的未来。

目前因为各种文字、语音、图像、视频的生成式AI发展太快,导致我们现在看到一个现场照片,都无法判断是不是AI生成的。而越来越多人靠GPT类的引擎去查询知识,很快,AI内容就会污染到目前的人类语料库,让人更加难以辨别真相。无论马斯克是不是要做真相AI,各种机构特别是新闻机构,的确要开发新的工具来甄别真相,帮助人们看清楚这个世界。

第二,即便有AI能准确客观地记录这个世界,也存在一个很麻烦的问题,有些真相可能无法是稳定的版本,在很大程度上是投票下的共识,也就是社会学家讨论的“谁的真相”的问题。到底是无耻偷情,还是自由恋爱,这完全要看观察者本身的立场。

但在这个问题上,AI帮不了太多的忙。你再迅速算出全人类的共识,如果我一个人觉得委屈了,那正义就没降临在我身上。即便别人对我的污蔑,AI算出全社会都接受了,那对我来说,也是愤恨难平。甚至特朗普都带人闹国会了,他真诚地相信他的总统大位被拜登偷走了。

所以什么是真相的问题,浅层次上,AI能解决,只要构建更好的世界模型,但在深层次上,是人类政治本身,这大概会是永恒的难题。

这也是我们对正在降临的奇点、通用人工智能的看法。是的,AI能以更大的效率和能力改变人类社会,但只要人类存在,政治永远是最会造成冲突的重点问题之一。虽然我们要努力用“魔法打败魔法”,但归根到底,人的自由意志依然是最后一片自留地,它混乱、偏狭、低效,但这是我们区别于人工智能的全部。

其实即便奇点降临,这个世界的大部分地方还是传统的非AI的社会,我们人遇到的更大的挑战,不是科技带来的,而是自然和政治带来的。

© 2025 现代传播 Modern Media Co,Ltd.

© 2025 现代传播 Modern Media Co,Ltd.